El riesgo de los deepfakes está en aumento, y casi la mitad de las organizaciones (47%) han encontrado uno mientras que tres cuartas partes de ellas (70%) creen que los ataques que se crean utilizando herramientas de IA generativa, tendrán un alto impacto en sus organizaciones.

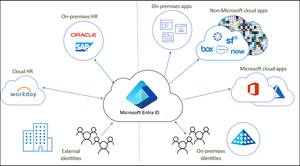

Sin embargo, las percepciones sobre la IA son optimistas, ya que dos tercios de las organizaciones (68%) creen que, si bien tiene un impacto en la creación de amenazas cibernéticas, más (84%) consideran que es fundamental para protegerse contra ellas. Esto según una nueva encuesta global de iProov, un proveedor líder de soluciones de identidad biométrica basadas en la ciencia, la cual también encontró que tres cuartas partes (75%) de las soluciones que se están implementando para abordar la amenaza de los deepfakes son soluciones biométricas.

The Good, The Bad, and The Ugly

"The Good, The Bad, and The Ugly" es una encuesta global encargada por iProov que reunió las opiniones de 500 tomadores de decisiones en tecnología del Reino Unido, EE.UU, Brasil, Australia, Nueva Zelanda y Singapur sobre la amenaza de la IA generativa y los deepfakes.

Mientras las organizaciones reconocen las mayores eficiencias que la IA puede aportar, estos beneficios también son aprovechados por los desarrolladores de tecnología maliciosa y actores malintencionados. Casi tres cuartas partes (73%) de las organizaciones están implementando soluciones para abordar la amenaza de los deepfakes, pero la confianza es baja, ya que el estudio identifica una preocupación predominante de que no están haciendo lo suficiente para combatirlos. Más de dos tercios (62%) están preocupadas de no estar tomando la amenaza de los deepfakes con la seriedad necesaria.

La encuesta muestra que las organizaciones reconocen que la amenaza de los deepfakes es real y presente. Pueden ser utilizados contra las personas de diversas formas dañinas, incluyendo la difamación y el daño reputacional, pero quizás el riesgo más cuantificable es en el fraude financiero. Aquí, pueden ser utilizados para cometer fraudes de identidad a gran escala al hacerse pasar por individuos para obtener acceso no autorizado a sistemas o datos, iniciar transacciones financieras o engañar a otros para que envíen dinero, como en el reciente fraude de deepfake en Hong Kong.

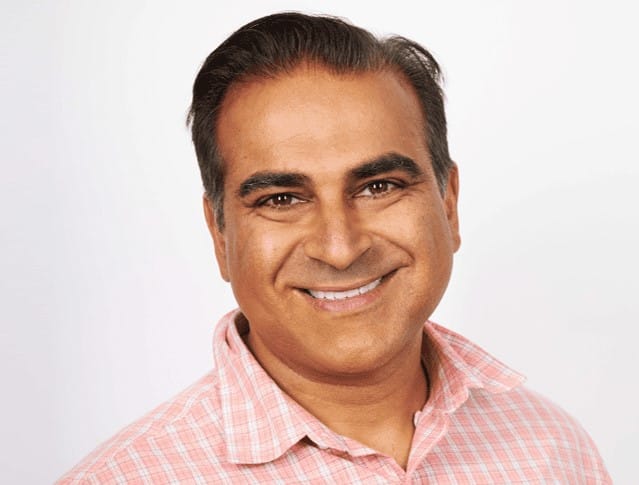

Andrew Bud, fundador y CEO de iProov, destacó que:

“...hemos estado observando los deepfakes durante años, pero lo que ha cambiado en los últimos seis a doce meses es la calidad y la facilidad con la que pueden ser creados y causar destrucción a gran escala tanto en organizaciones como en individuos”.

Quizás el uso de deepfakes más subestimado es la creación de identidades sintéticas que, al no ser reales y no tener un propietario que reporte su robo, pasan en gran medida desapercibidas mientras causan estragos y defraudan a organizaciones y gobiernos por millones de dólares, donde el ejecutivo recalcó que:

“...y a pesar de lo que algunos puedan creer, ahora es imposible para el ojo humano detectar deepfakes de calidad. Aunque nuestra investigación informa que la mitad de las organizaciones encuestadas han encontrado un deepfake, es probable que esta cifra sea mucho mayor, porque la mayoría de las organizaciones no están adecuadamente equipadas para identificarlos".

Con la rapidez con la que el panorama de amenazas está innovando, las organizaciones no pueden permitirse ignorar las metodologías de ataque resultantes y cómo la biometría facial se ha destacado como la solución más resiliente para la verificación de identidad remota”.