Por Claudio Gutiérrez, académico del Departamento de Ciencias de la Computación de la Facultad de Ciencias Físicas y Matemáticas de la Universidad de Chile.

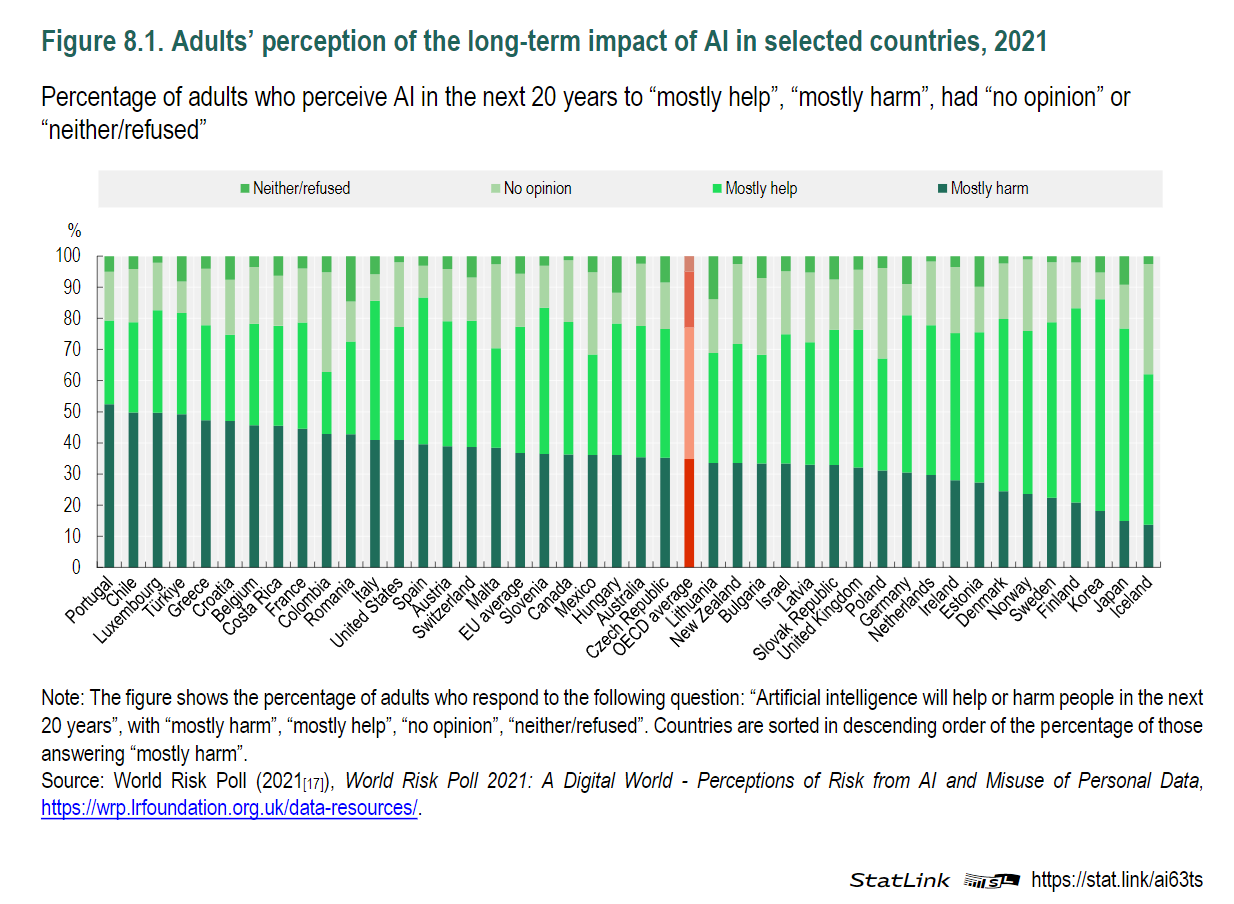

Según un informe de la OCDE*, cerca del 50% de los adultos en Chile cree que la inteligencia artificial (IA) causará daño, mientras que menos del 30% piensa que será beneficiosa. Estas cifras deberían preocuparnos.

La historia muestra que las tecnologías no son inherentemente peligrosas o beneficiosas. Algunas solo traen beneficios, como una lavadora o una silla de ruedas; otras, como un fármaco o un explosivo, dependen del uso que le demos; y otras han sido monopolizadas para usos nefastos como las armas o la cocaína.

La IA, como toda tecnología, es un hacer humano, luego sujeto a los dictados de quienes las desarrollan, quienes las regulan, quienes la usan. Con la IA esta obviedad se tiende a escamotear bajo el fantasma de la “autonomía”, de la supuesta “independencia”, de esta tecnología del control de los humanos, permitiendo así a quienes la manejan evadir las responsabilidades sociales.

Por ello es tan importante entender qué es la IA

La IA surge de las tecnologías digitales, que vienen desarrollando desde hace mucho, sorprendentes capacidades de cálculo, de memoria, de comunicación y automatización de tareas diversas. Hoy a todo eso se le ha agregado una tecnología que simula digitalmente redes neuronales y que ha permitido —sobre la base de usar masivamente datos que generamos entre todos— simular de muy buena manera el lenguaje humano. Todo ello reunido conforma artefactos que logran simular muchos aspectos del comportamiento y del hacer humano, que es lo que hoy usualmente se llama IA.

Basado en lo anterior, los peligros asociados con la IA aparecen en cuatro categorías: accidentes técnicos, como los autos sin conductor que causan daños; abusos, especialmente en la gestión y uso de datos personales; cambios sociales y económicos, como el trabajo, cuya transformación está desplazando unos y creando otros, perjudicando a unos y beneficiando a otros, y finalmente, la autonomía completa, esto es, la posibilidad de tomar decisiones por su cuenta (y volverse contra los humanos), una fantasía aún bastante lejana. Sobre todos estos peligros, es bueno repetir: No es “la tecnología” quien amenaza o la responsable, sino las personas y el orden social donde esas tecnologías se desarrollan.

Entonces, para evitar los temores, es bueno conocer qué es la IA, dominarla y regularla. Las fallas técnicas se combaten aprendiendo y con regulaciones estrictas para testear los productos antes de su uso masivo. Para los abusos, una legislación y la responsabilidad personal sobre nuestros datos es crucial; para los cambios sociales, responsabilidad política y participación en el direccionamiento de los desarrollos de la IA; y para la autonomía de la IA, ahora que conocemos qué es, tranquilidad ante estas fantasías de futuro.

En resumen, contra los temores ante la IA, aprender, conocer, impulsar regulaciones y políticas y participar en su desarrollo y sus usos éticos. El peligro real no es que la IA se vuelva contra nosotros, sino que los grupos con poder la usen a su gusto, contra una ciudadanía ignorante de sus posibilidades y alcances. Depende de todas y todos nosotros evitarlo.